Bienvenido a The Background, en esta ocasión te presento una recopilación de los 10 artículos mas populares sobre inteligencia artificial de esta semana, espero esta lectura te sea de ayuda para ampliar tus conocimientos y habilidades:

1. OMG-LLaVA: Bridging Image-level, Object-level, Pixel-level Reasoning and Understanding

Este artículo propone OMG-LLaVA, un nuevo marco que combina una poderosa comprensión de visión a nivel de píxeles con habilidades de razonamiento. Acepta varios prompts visuales y de texto para una interacción flexible, logrando un razonamiento y comprensión a nivel de imagen, objeto y píxel en un solo modelo.

The Background Note📝: Este trabajo busca unir las capacidades de modelos multimodales de visión y lenguaje con la comprensión detallada a nivel de píxel, lo que podría ser un gran paso hacia una inteligencia artificial más versátil y controlable.

2. Step-DPO: Step-wise Preference Optimization for Long-chain Reasoning of LLMs

Step-DPO es un método que optimiza preferencias de pasos individuales en el razonamiento matemático de LLMs, mejorando la precisión en tareas largas. Proponen un conjunto de datos de alta calidad y demuestran mejoras significativas en modelos de más de 70B parámetros.

The Background Note📝: Este enfoque incrementa la robustez y la factualidad de los LLMs en razonamientos complejos, un avance crítico para aplicaciones matemáticas precisas y detalladas.

3. Scaling Synthetic Data Creation with 1,000,000,000 Personas

Propone un método de síntesis de datos impulsado por 1,000 millones de personajes diversos, facilitando la creación de datos sintéticos para diversas aplicaciones. La metodología destaca por su escalabilidad y versatilidad.

The Background Note📝: La creación de datos sintéticos a gran escala puede revolucionar el entrenamiento de modelos LLMs, proporcionando una diversidad sin precedentes y potenciando la calidad del aprendizaje automático.

4. HuatuoGPT-Vision, Towards Injecting Medical Visual Knowledge into Multimodal LLMs at Scale

HuatuoGPT-Vision mejora las capacidades multimodales médicas de los LLMs utilizando el conjunto de datos PubMedVision, refinado y denoised con 1.3 millones de muestras VQA médicas.

The Background Note📝: Este trabajo aborda los desafíos en el manejo de datos médicos visuales, proporcionando un enfoque robusto para mejorar la precisión y utilidad de los LLMs en el campo médico.

5. We-Math: Does Your Large Multimodal Model Achieve Human-like Mathematical Reasoning?

WE-MATH es un benchmark diseñado para evaluar el razonamiento matemático visual de los LMMs, utilizando una métrica de cuatro dimensiones para identificar problemas inherentes en el proceso de razonamiento.

The Background Note📝: Este benchmark proporciona una evaluación detallada de las capacidades de razonamiento matemático de los LMMs, destacando áreas clave para la mejora en la comprensión y generalización del conocimiento.

6. ROS-LLM: A ROS framework for embodied AI with task feedback and structured reasoning

ROS-LLM es un marco para la programación intuitiva de robots, integrando modelos de lenguaje grandes (LLMs) con el sistema operativo de robots (ROS) para facilitar la interacción y aprendizaje de nuevas acciones a través de prompts de lenguaje natural.

The Background Note📝: La integración de LLMs con ROS ofrece una plataforma poderosa para la programación de robots, simplificando la interfaz y ampliando las capacidades de aprendizaje y adaptación de los sistemas robóticos.

7. Summary of a Haystack: A Challenge to Long-Context LLMs and RAG Systems

Presenta SummHay, un desafío para evaluar la calidad de los resúmenes generados por LLMs y sistemas RAG en tareas de contexto largo, utilizando un procedimiento sintetizado para garantizar la relevancia y precisión en las respuestas.

The Background Note📝: SummHay resalta las dificultades actuales en la generación de resúmenes de alta calidad por parte de LLMs y RAGs, subrayando la necesidad de mejoras en el manejo de contextos largos y complejos.

8. OpenVid-1M: A Large-Scale High-Quality Dataset for Text-to-video Generation

OpenVid-1M es un conjunto de datos de alta calidad para la generación de videos a partir de texto, compuesto por más de un millón de pares texto-video y curado específicamente para mejorar la generación de videos de alta definición.

The Background Note📝: Este conjunto de datos puede impulsar significativamente el campo de la generación de video a partir de texto, proporcionando un recurso valioso para investigaciones futuras y aplicaciones prácticas en el ámbito multimedia.

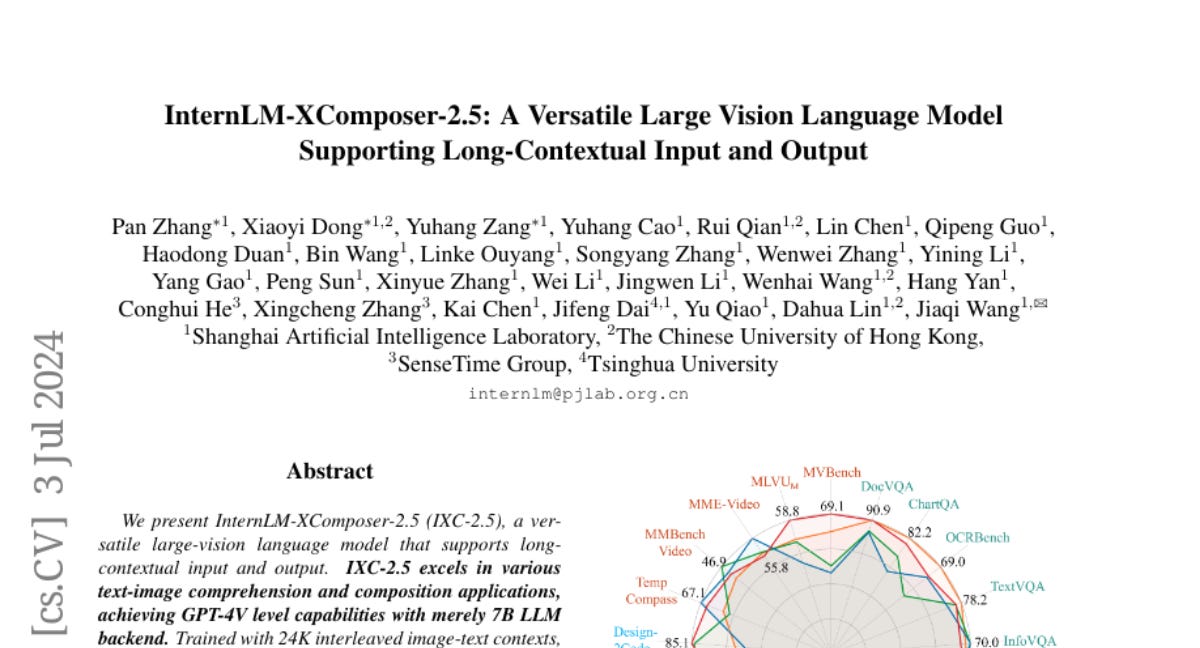

9. InternLM-XComposer-2.5: A Versatile Large Vision Language Model Supporting Long-Contextual Input and Output

InternLM-XComposer-2.5 es un modelo versátil que soporta entradas y salidas contextuales largas, destacándose en la comprensión y composición texto-imagen de alta resolución y en diálogos multi-turno.

The Background Note📝: Este modelo podría establecer un nuevo estándar en la interacción multimodal, combinando capacidades de alta resolución con un manejo eficiente de contextos extensos.

10. TabReD: A Benchmark of Tabular Machine Learning in-the-Wild

TabReD es una colección de ocho conjuntos de datos tabulares de grado industrial que abordan la evolución temporal y la ingeniería de características, proporcionando un benchmark robusto para la evaluación de modelos de ML en escenarios reales.

The Background Note📝: Este benchmark es crucial para evaluar de manera más precisa la efectividad de los modelos de ML en contextos del mundo real, destacando la importancia de los datos temporales y las características derivadas en la modelización.

¡Espero que disfrutes de la lectura y encuentres estas investigaciones tan fascinantes como nosotros!